Les tests A/B transforment votre approche de l'optimisation web en vous permettant de prendre des décisions basées sur des données concrètes plutôt que sur des intuitions. Selon une étude Conversion Rate Optimization Report, les entreprises utilisant l'A/B testing de manière systématique augmentent leurs taux de conversion de 49% en moyenne. Comment votre parcours client pourrait-il bénéficier de cette approche scientifique pour maximiser chaque interaction ?

Pourquoi cette méthode transforme-t-elle concrètement vos performances digitales ?

L'ab testing révolutionne votre approche digitale en transformant vos intuitions en décisions éclairées. Cette méthodologie permet d'augmenter vos taux de conversion de 15 à 25% en moyenne, selon les études récentes du secteur.

Concrètement, chaque test valide ou invalide une hypothèse précise. Un simple changement de couleur sur un bouton d'appel à l'action peut générer 21% de conversions supplémentaires. L'optimisation d'un formulaire d'inscription réduit souvent le taux d'abandon de 30%. Ces améliorations s'accumulent pour créer un effet multiplicateur sur vos performances globales.

L'approche data-driven élimine les biais cognitifs qui faussent traditionnellement les décisions marketing. Plutôt que de se fier aux préférences personnelles, vous mesurez objectivement l'impact réel de chaque modification sur le comportement de vos utilisateurs. Cette rigueur méthodologique transforme votre site en véritable machine d'optimisation continue.

Les entreprises qui adoptent cette culture de l'expérimentation constatent également une amélioration significative de l'expérience utilisateur, avec des temps de session prolongés et un taux de rebond réduit de 20% en moyenne.

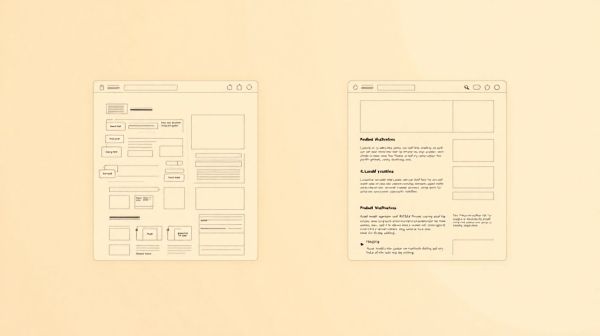

Comment utiliser le test A/B efficacement : la méthodologie en 6 étapes clés

Une approche méthodique garantit la fiabilité statistique de vos tests A/B. Suivre un processus structuré évite les biais qui compromettent l'analyse des résultats et maximise l'impact de vos optimisations.

- Définir des objectifs mesurables : Identifiez précisément le KPI à améliorer (taux de conversion, durée de session, revenus par visiteur) et fixez un seuil de significativité statistique minimum de 95%

- Formuler une hypothèse claire : Basez-vous sur des données comportementales existantes pour proposer une modification spécifique et justifier pourquoi elle devrait améliorer les performances

- Créer les variantes de test : Développez la version alternative en ne modifiant qu'un seul élément à la fois pour isoler l'impact de chaque changement

- Configurer l'environnement technique : Répartissez le trafic équitablement entre les versions, définissez la durée du test et paramétrez le suivi des conversions

- Lancer et monitorer : Surveillez quotidiennement l'évolution des métriques sans interrompre prématurément le test, même si les résultats semblent évidents

- Analyser avec rigueur : Vérifiez la significativité statistique, calculez l'intervalle de confiance et documentez les enseignements pour alimenter les futurs tests

Maîtriser les paramètres statistiques pour des résultats fiables

La validité statistique constitue le pilier fondamental de tout test A/B réussi. Sans une méthodologie rigoureuse, vos résultats risquent de vous induire en erreur et de compromettre vos décisions d'optimisation.

La taille d'échantillon représente le premier paramètre critique à déterminer. Un échantillon trop faible génère des résultats instables, tandis qu'un échantillon surdimensionné prolonge inutilement la durée du test. La règle générale recommande au minimum 1 000 conversions par variante pour détecter des différences significatives de 10 à 20%.

Le seuil de signification statistique fixé à 95% garantit que vos résultats ne sont pas dus au hasard. Parallèlement, la puissance du test, généralement établie à 80%, assure votre capacité à détecter une différence réelle quand elle existe. Ces deux métriques travaillent ensemble pour valider la robustesse de vos conclusions.

La durée optimale dépend de votre trafic et de vos cycles d'activité. Respectez au minimum une semaine complète pour capturer les variations comportementales, et prolongez jusqu'à obtenir la taille d'échantillon requise tout en maintenant la stabilité des résultats.

Ces erreurs qui compromettent vos campagnes d'expérimentation

L'arrêt prématuré d'un test représente l'écueil le plus fréquent en test A/B. Face à des résultats prometteurs après quelques jours, la tentation est grande de conclure rapidement. Cette précipitation conduit pourtant à des décisions basées sur des fluctuations temporaires plutôt que sur des tendances statistiquement significatives.

Les échantillons insuffisants constituent le second piège majeur. Lancer un test sur 200 visiteurs par semaine pour détecter une amélioration de 5% relève de l'impossible statistique. Cette sous-estimation des volumes nécessaires génère des résultats non concluants qui paralysent la prise de décision.

Le biais de confirmation pousse également les équipes à interpréter les données selon leurs attentes initiales. Quand la version B performe moins bien, on cherche des explications externes plutôt que d'accepter l'échec de l'hypothèse. Cette attitude fausse l'analyse et compromet l'apprentissage organisationnel.

La sur-interprétation transforme enfin une victoire ponctuelle en règle universelle, négligeant les spécificités contextuelles du test réalisé.

Quelle stratégie adopter pour une culture d'expérimentation durable ?

Construire une culture d'expérimentation durable nécessite une approche méthodologique qui dépasse les tests ponctuels. L'objectif est d'intégrer l'expérimentation dans l'ADN de l'organisation, où chaque décision produit s'appuie sur des données concrètes plutôt que sur des intuitions.

La formation des équipes constitue le socle de cette transformation. Les collaborateurs doivent maîtriser les fondamentaux statistiques, comprendre les biais cognitifs et savoir interpréter les résultats. Cette montée en compétences permet d'éviter les erreurs méthodologiques qui compromettent la fiabilité des tests.

L'intégration dans la roadmap produit représente l'étape cruciale. Chaque nouvelle fonctionnalité doit être pensée comme une hypothèse à valider. Cette approche impose de définir des indicateurs clés de performance avant le développement et d'allouer le temps nécessaire aux phases de test.

La mesure de l'impact business transforme l'expérimentation en levier stratégique. Au-delà des métriques techniques, il faut quantifier l'effet sur le chiffre d'affaires, la satisfaction client et la rétention. Cette vision globale justifie les investissements et pérennise la démarche d'amélioration continue.

Vos questions sur l'optimisation par tests comparatifs

Comment faire un test A/B sur mon site web ?

Définissez votre objectif mesurable, créez deux versions de votre page, divisez aléatoirement votre trafic puis mesurez les performances. Utilisez un outil spécialisé pour garantir la fiabilité statistique des résultats.

Quelle est la durée idéale pour un test A/B ?

Comptez minimum 2 semaines complètes pour capturer les variations comportementales. La durée dépend de votre trafic et du niveau de significativité souhaité. Évitez d'arrêter prématurément un test prometteur.

Combien de visiteurs faut-il pour un test A/B fiable ?

Minimum 1000 visiteurs par variante pour une première approche. Pour des résultats statistiquement robustes, visez 5000 visiteurs par version avec au moins 200 conversions pour détecter des écarts significatifs.

Quels outils utiliser pour faire des tests A/B ?

Google Optimize (gratuit), Optimizely et VWO pour les solutions avancées. Les plateformes e-commerce intègrent souvent des modules natifs. Choisissez selon votre budget et niveau technique requis.

Comment analyser les résultats d'un test A/B ?

Vérifiez la significativité statistique (minimum 95%), analysez le taux de conversion et l'impact sur le chiffre d'affaires. Documentez les apprentissages pour alimenter vos futurs tests d'optimisation.